Platform- und Engineering-Teams

Teams, die Agents, Copilots oder Automationssysteme bauen, die Tools aufrufen, Daten ändern, Repositories modifizieren oder Business-Aktionen auslösen können.

Publications

TNT Intelligence baut die operative Schicht zwischen Governance, Runtime-Kontrolle und vertrauenswürdiger autonomer Ausführung.

Dieser Bereich zeigt Arbeit, die bereits existiert. TNT veröffentlicht nicht nur abstrakte Positionierung zu Verantwortung und Entscheidungsarchitektur, sondern konkrete Artefakte für governte Delegation, Runtime-Enforcement, Integration und vertrauenswürdige Autonomie.

Das Ergebnis ist kein weiterer Agent-Orchestration-Stack. Im Fokus steht die schwierigere Frage hinter folgenreichen AI-Systemen: Unter welchen Bedingungen darf ein System tatsächlich handeln, und wie wird das praktisch durchgesetzt?

Je stärker der AI Act Governance-Fragen in echten Umsetzungsdruck überführt, desto weniger reichen reine Policies aus. Organisationen brauchen Operating Models, die Use Cases einordnen, Verantwortung zuweisen, Ausführung begrenzen und Auditierbarkeit erhalten.

Genau diese Lücke adressiert TNT hier, und die Architektur folgt einer klaren Abfolge: GTAF liefert das Governance-Modell, Runtime erzwingt es, SDK bringt es in reale Systeme, und ITA erweitert dieselbe Logik in Richtung Trusted Autonomy statt improvisierter Orchestrierung.

GTAF definiert explizite Artefakte für Scope, Entscheidungsautorität, Verantwortung, Gültigkeit und Intervention, statt sich auf Fließtext oder nachträgliche Interpretation zu verlassen.

Zum Bereich

GTAF Runtime überführt ausgewertete Governance-Outputs in ausführbare Allow-/Deny-Entscheidungen. Genau dort hört Governance auf, rein beschreibend zu sein, und wird operativ.

Zum Bereich

GTAF SDK verkleinert die Adoptionslücke zwischen Governance-Artefakten und funktionierenden Softwaresystemen, ohne die Semantik des Runtime-Kerns zu verändern.

Zum Bereich

ITA überführt dieselbe Logik in governte Execution Spaces, sichtbare Capability Surfaces und eine auditierte Enforcement Boundary für reale externe Effekte.

Zum Bereich

Teams, die Agents, Copilots oder Automationssysteme bauen, die Tools aufrufen, Daten ändern, Repositories modifizieren oder Business-Aktionen auslösen können.

Entscheider, die AI-Systeme brauchen, die mehr leisten als gute Prototypen. Sie brauchen Systeme, die produktiv handeln können, ohne Verantwortlichkeit aufzulösen.

Organisationen, die bei folgenreichen Use Cases mit AI-Act-Anforderungen zu Risikoklassifizierung, Oversight, Dokumentation, Logging, Robustheit und Kontrollierbarkeit umgehen müssen.

Ausführungsrechte sind an governte Kontexte und Gültigkeit gebunden, nicht an das permanente Label eines Agents oder Service Accounts.

Das architektonische Ziel ist, reale Effekte zu begrenzen, bevor sie passieren, und versuchte, verweigerte und ausgeführte Aktionen auditierbar zu halten.

Planung und Tool-Routing sind nützlich, aber sie sind keine Autorität. Die Arbeit von TNT fokussiert die Kontrollschicht unterhalb der Ausführung.

AI-Systeme, die Dokumente prüfen, Freigaben vorschlagen, interne Aktionen auslösen oder mit Business-APIs interagieren, bei denen Verantwortlichkeit nicht wegabstrahiert werden kann.

Umgebungen, in denen Autorität, Nachvollziehbarkeit, Intervention und Scope-Disziplin wichtiger sind als reine Automationsgeschwindigkeit.

Release-Agents, Repo-Tooling, CI/CD-Automation oder operative Assistenten, die nützlich handeln sollen, ohne stillschweigend blanket privileges anzusammeln.

Produkte, die über Chat oder Empfehlungen hinausgehen und so gestaltet werden müssen, dass reale Effekte begrenzt, reviewbar und interventionsfähig bleiben.

Die Architekturschicht für Systeme, die bei realer Wirkung zugleich nützlich, governable und auditierbar bleiben müssen.

Infrastructure for Trusted Autonomy

Öffentliches Architekturmodell

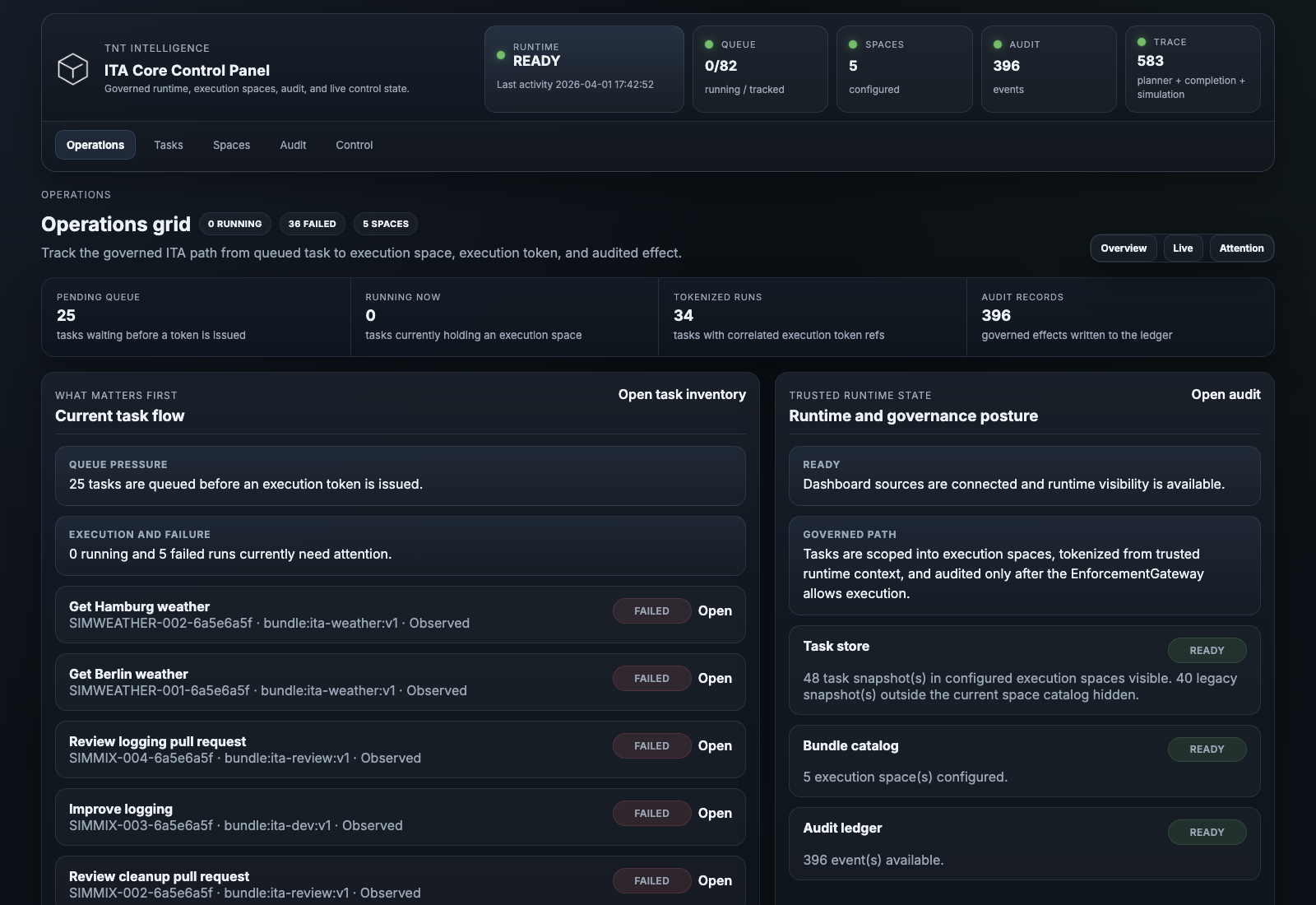

Eine Runtime-Architektur für Systeme, die mit realer Wirkung handeln müssen und zugleich governable bleiben sollen. ITA erweitert GTAF um Execution Spaces, Capability Exposure, Enforcement und Audit.

ITA Dashboard

Gezeigt wird hier ein Beispiel für ein Control Panel, das auf ITA aufsetzt. Der Kern liegt in der Architektur darunter: Execution Spaces, Capability Visibility, Enforcement und Audit, abgeleitet aus GTAF und in die Runtime erweitert.

Architektonisch interessant wird ITA dort, wo GTAF in Execution Spaces, Enforcement und Audit zur Laufzeit übersetzt wird.

Execution Spaces, Enforcement und Audit verstehenDie Governance-Schicht, um Risiko einzuordnen, Autorität zu definieren und delegiertes Handeln strukturell lesbar zu machen.

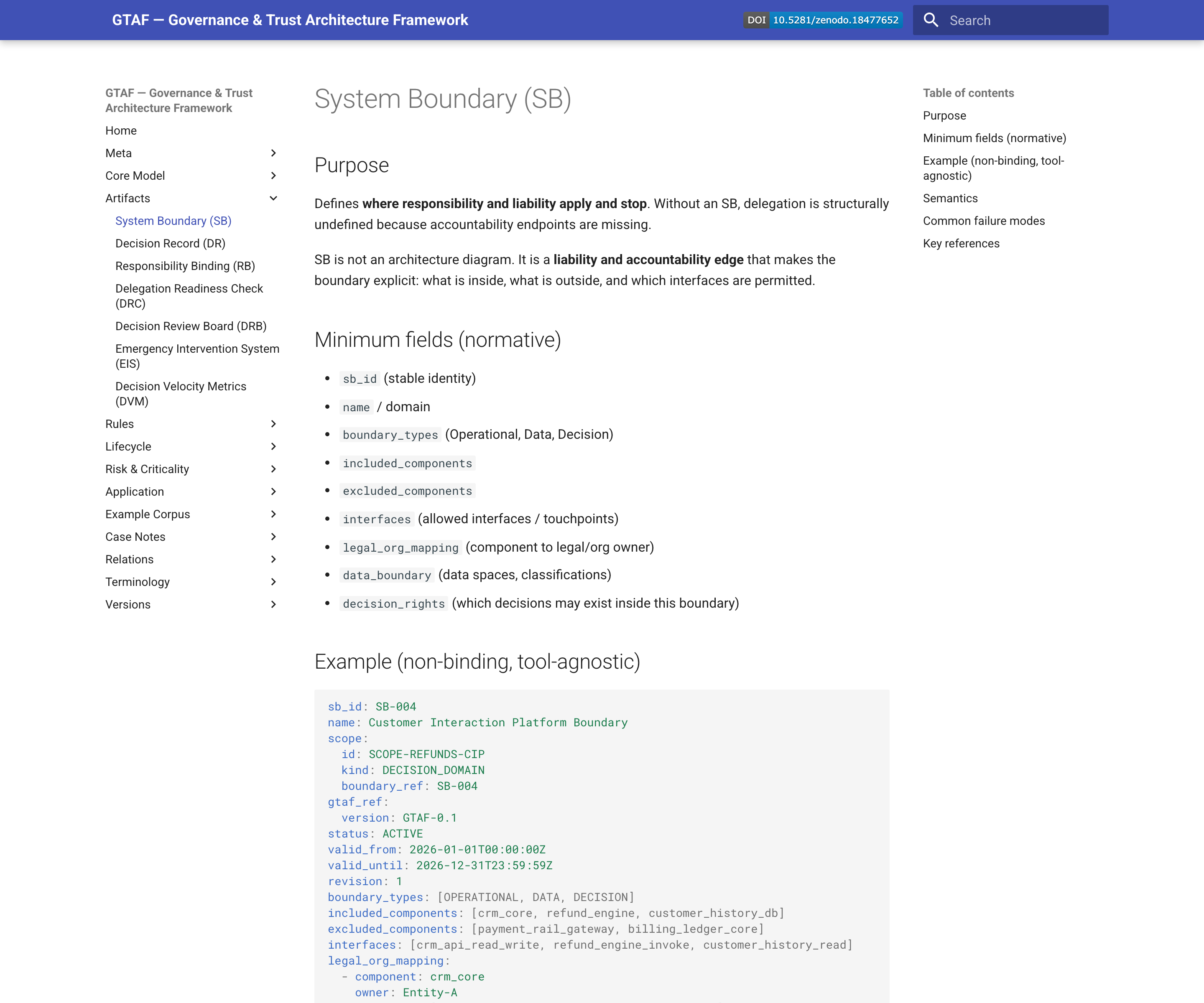

Öffentliche normative Referenz

Ein Governance-Framework für AI-Systeme, die handeln, delegieren oder folgenschwere Effekte auslösen können. GTAF überführt Scope, Autorität, Verantwortung und Gültigkeit in strukturierte operative Artefakte.

GTAF Reference

Die öffentliche Referenz zeigt GTAF bereits als konkretes Artefaktsystem: Governance strukturiert in Boundaries, Records, Bindings, Lifecycle-Logik und explizite Permission States.

Relevant wird GTAF dort, wo Governance aufhört, Fließtext zu sein, und zu expliziten Artefakten, Entscheidungslogik und Validitätszuständen wird.

Das GTAF-Artefaktmodell erkundenDie Kontrollschicht, die Governance-Entscheidungen in ausführbares Systemverhalten und nutzbare Integrationspfade überführt.

Öffentlicher Runtime-Kern · Referenzimplementierung verfügbar

Der Enforcement-Kern, der ausgewertete Governance-Outputs in ausführbare Allow-/Deny-Entscheidungen überführt. Die öffentliche Implementierung zeigt den Vertrag, aber das Runtime-Modell reicht über eine einzelne Sprache hinaus.

Interessant wird hier der Schritt, an dem ausgewertete Governance-Artefakte in binäre Ausführungsentscheidungen mit expliziten Reason Paths übergehen.

Sehen, wie Governance zu Runtime-Enforcement wirdÖffentliche Integrationsschicht · Referenzimplementierung verfügbar

Die Adoptionsschicht, die realen Systemen hilft, Artefakte zu laden, Execution Context zu formen und die Runtime sauber aufzurufen. Die öffentliche Implementierung ist ein konkreter Pfad, aber das Integrationsmodell ist nicht sprachspezifisch.

Die eigentliche Frage ist hier, wie Governance-Artefakte und Runtime-Verträge ohne semantische Drift in reale Systeme gelangen.

Die GTAF-Integrationsschicht verstehenPolicy- und Regulierungsdruck in Decision Layers, accountable Rollen, explizite Scope-Grenzen und konkrete Governance-Artefakte übersetzen.

Die Grenze zwischen AI-Vorschlägen und realen externen Effekten so gestalten, dass Systeme nützlich handeln können, ohne jenseits ihres Mandats zu agieren.

Teams unterstützen, die mehr als Orchestrierung brauchen: Produkt-, Plattform- und Architekturarbeit für Systeme, die im Betrieb governable bleiben müssen.

Von GTAF über Runtime und SDK bis hin zu ITA bringt TNT bereits öffentliche Referenzarbeit, Runtime-Bausteine und angewandte Architektur in diese Fragen ein. Das Gespräch muss also nicht bei Theorie beginnen.

Wenn diese Fragen vom Interesse in die Umsetzung kippen, ist TNT ein belastbarer Gesprächspartner.

Kontext besprechen